有了 Auto-GPT,ChatGPT 已沦为“传统 GPT”

根据官方介绍,Auto-GPT 本质上是一个基于 GPT-4 语言模型所构建的实验性开源应用程序,由 GPT-4 驱动,将大型语言模型 (LLM) 思想串在一起来自主实现任务。

如果说 ChatGPT 的出现让人相信未来 AI 的重要性,Auto-GPT 则将这个想法进一步升华:未来,由自主 AI 驱动的任务将成为常态。因 Auto-GPT 提出的这个可能,导致 ChatGPT 问世不到半年就已沦为许多人口中的“传统 GPT”。

为了验证这种未来的可能性,最近已有不少人下场体验过 Auto-GPT,其中包括微博博主@木遥:“如果你刚开始玩 Auto-GPT 但又没玩明白,你就会焦虑 af,像我一样。”

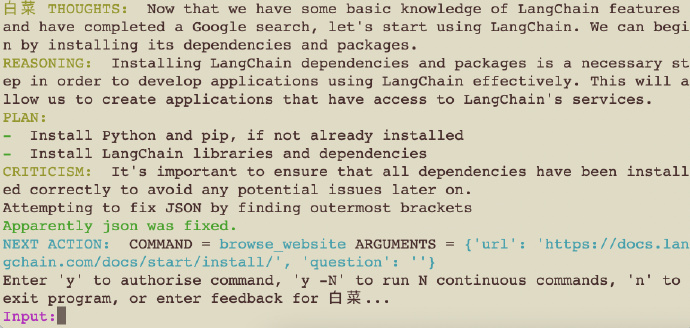

本来,木遥只是想让 Auto-GPT 解释一下 LangChain(一个围绕大型语言模型的应用开发框架)的用法,结果 Auto-GPT 直接来了一整套操作(这一系列步骤都是它自己串起来的,无需人类介入),连 LangChain 都安装了:

▶ 首先试着直接去 LangChain 官网爬信息。

▶ 被官网拒绝了,可能因为有屏蔽。

▶ 发现失败了之后想了想,说要不 Google 一下?

▶ Google 出了很多结果。

▶ 读了半天这些结果,说「现在我们已经搜集了不少有用的信息了,接下来让我们安装它玩一下」

▶ 然后就开始动手在我的电脑上安装 LangChain……

面对行动力如此“爆表” Auto-GPT,木遥忍不住感慨:“我坐在屏幕前看着这一切自动在我眼前发生,心想,我要是有它这个行动力,三个 PhD 都念完了。”

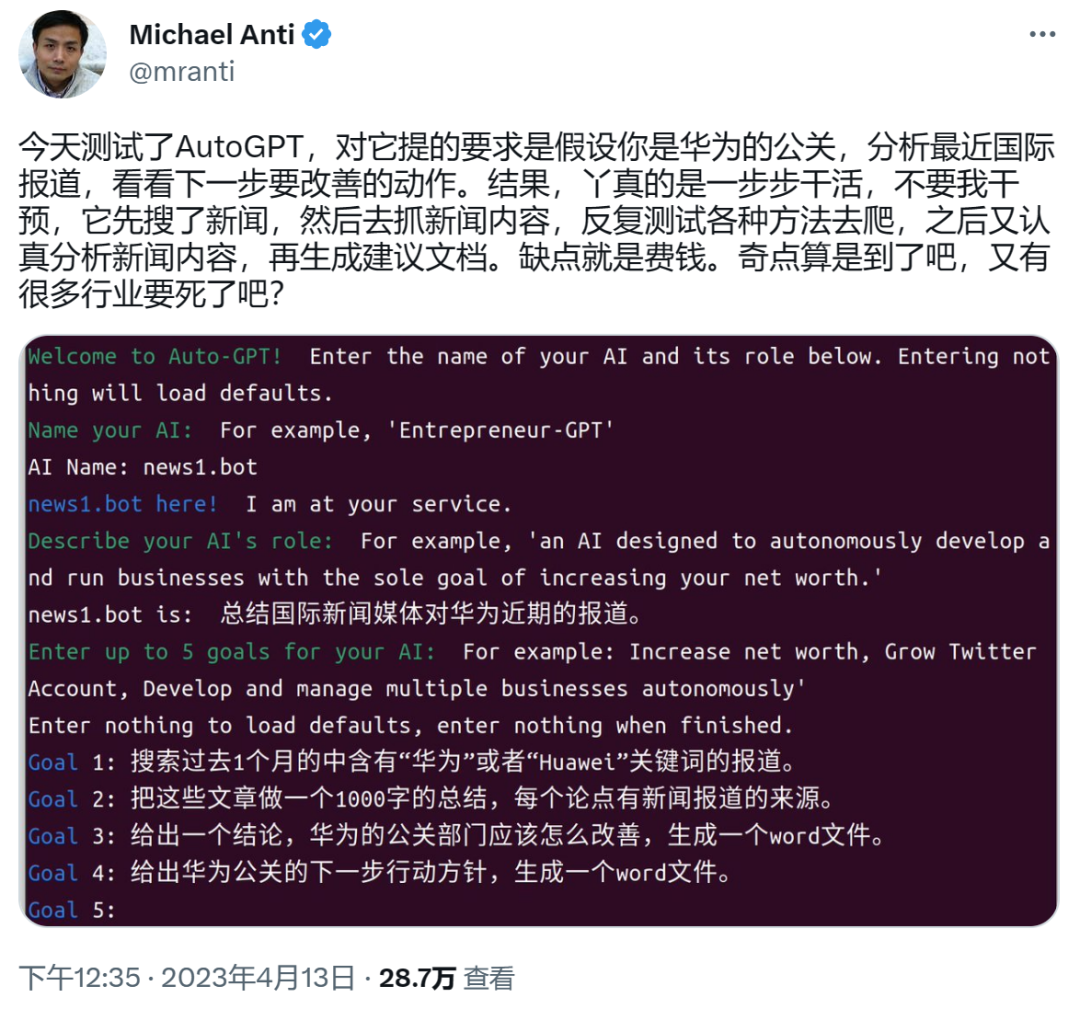

除此之外,Globus 创始人安替(Michael Anti)也分享了一个不错的 Auto-GPT 使用案例:“假设你是华为的公关,分析最近国际报道,看看下一步要改善的动作。”

对于 Auto-GPT 的表现,安替(Michael Anti)评价道:“奇点算是到了吧,又有很多行业要死了吧?”

整体来看,Auto-GPT 就像是一个机器人助理,你只需下达任务,它便会自己看着完成。但 Auto-GPT 真就完美无缺、无懈可击吗?

事实证明,至少现阶段还远远不是——Jina AI 的创始人兼 CEO 肖涵表示:“在我们庆祝 Auto-GPT 的快速崛起时,退后一步并仔细检查其潜在的缺点至关重要。”

现阶段,Auto-GPT 仍有缺陷

为说明目前 Auto-GPT 的不足之处,肖涵先大致分析了一波原理,即 Auto-GPT 主要由四部分组成:

(1)架构:Auto-GPT 是使用强大的 GPT-4 和 GPT-3.5 语言模型构建的,它们作为机器人的大脑,帮助它思考和推理。

(2)自主迭代:类似于机器人从错误中学习的能力。Auto-GPT 可以回顾其工作,在之前的工作基础上再接再厉,并利用其历史记录生成更准确的结果。

(3)内存管理:与矢量数据库(一种内存存储解决方案)集成,使 Auto-GPT 能够保留上下文并做出更好的决策,类似于为机器人配备长期记忆以记住过去的经历。

(4)多功能性:Auto-GPT 的功能(例如文件操作、Web 浏览和数据检索)使其用途广泛,并使其与有别于以往的 AI 迭代,就像赋予机器人多种技能来处理更广泛的任务。

基于其组成原理,肖涵指出现阶段 Auto-GPT 面临的五个重要局限:

▶ 成本高昂

虽然 Auto-GPT 具有卓越的功能,但由于任务是通过思维链完成的,为提供更好的推理和提示,每一步都需要调用昂贵的 GPT-4 模型,这通常会最大化 token,也就带来了过高的成本。

对此,肖涵估算了一个小任务的花费:Auto-GPT 平均需要 50 个步骤来完成一个小任务,即成本为 50* 0.288=14.4 美元(约人民币 98.5 元)。

▶ 不知变通

可能会有人觉得只要 Auto-GPT 能完成任务,这 14.4 美元倒也不亏。但问题是,这 14.4 美元是一次性的:哪怕你只想修改一个很小的任务条件,也需要再次支付 14.4 美元。

肖涵指出:“一旦生成过解决方案,再次花费相同的金额来调整参数似乎不合逻辑。这揭示了 Auto-GPT 的一个基本问题:它无法将开发和生产区分开来。”

▶ 容易陷入死循环

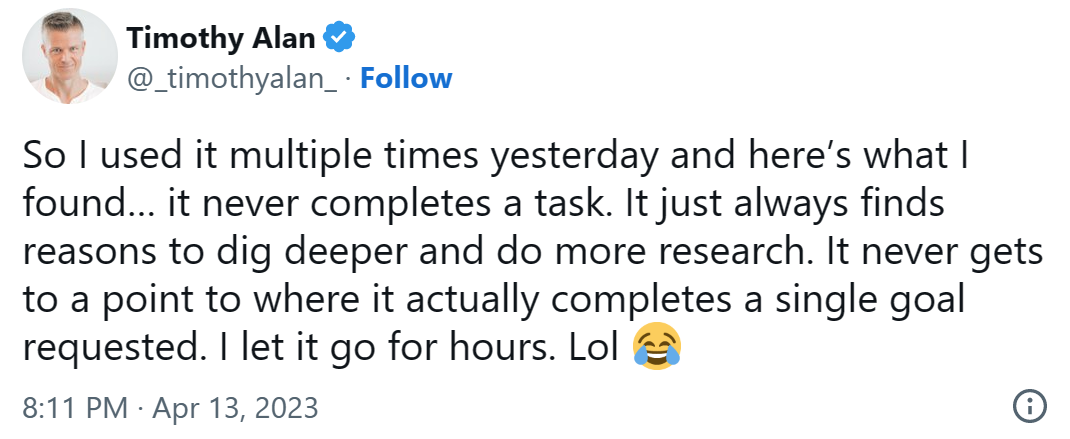

更要命的是,这 14.4 美元还可能“打水漂”。许多用户报告说:Auto-GPT 经常陷入循环,导致其无法解决实际问题。

“我昨天多次使用它,我发现…它从未完成过一项任务。它总是去深入挖掘、做更多的研究,但从来没有真正完成一个目标。我就放着让它持续循环了几个小时。”

▶ 矫枉过正

Auto-GPT 依靠矢量数据库来进行更快的 K 最近邻(KNN)搜索,但肖涵表示这是一种矫枉过正的做法:“很多情况下,穷举搜索就足够有效了,只需不到一秒钟即可完成。相比之下,每个 GPT-4 调用大约需要 10 秒来处理,这使得系统受 GPT 约束而不是数据库约束。”同时,这也会带来成本的增加。

▶ 代理机制不完善

Auto-GPT 引入了一个很有趣的概念,即允许生成代理来委派任务。然而,肖涵认为这还不够完善:“这一机制仍处于早期阶段,其潜力在很大程度上仍未得到开发。”

“又贵又慢,AI 摸鱼?”

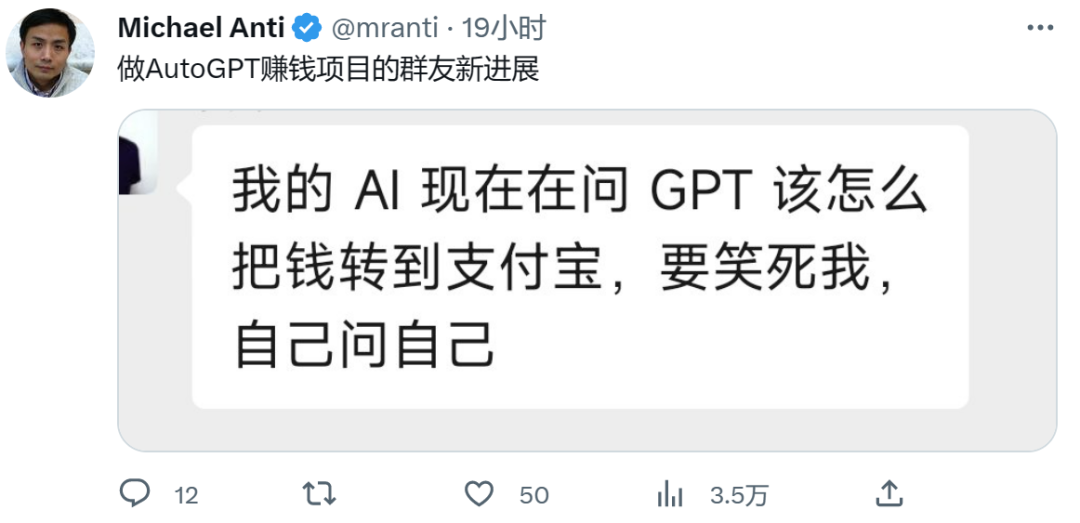

对于以上总结的几点 Auto-GPT 缺陷,实际上早有不少用户在抱怨,还搞出了一些“闹剧”:

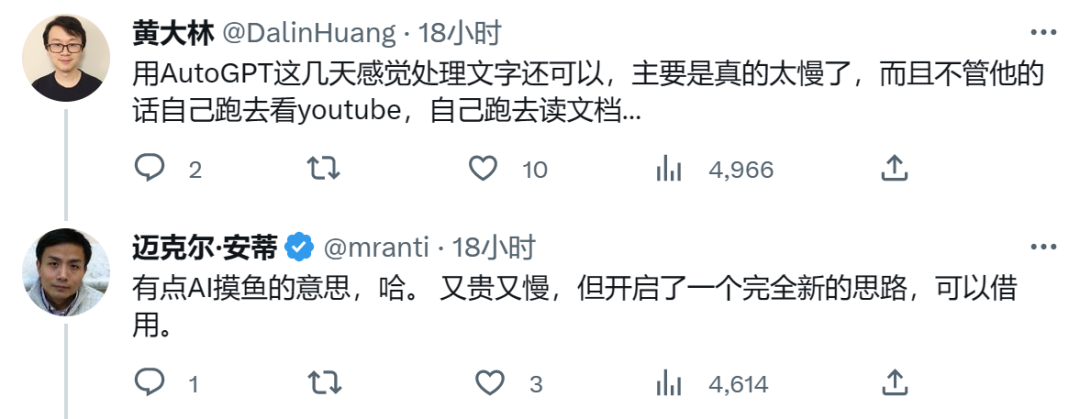

同时,Auto-GPT 的处理速度也引来吐槽,有点“AI 摸鱼”的意思:

不过即便如此,Auto-GPT 还是令许多人对未来 AI 的发展趋势充满期待:

▶ “想象一下,你手里有一个 AI 代理,可以随时随地执行命令。我相信未来才刚刚开始!”

▶ “这种自我改进的 AI 代表了真正 AGI 的第一个火花。”

▶ “Auto-GPT 的确揭露了使用 GPT 的正确姿势。”

那么,你对于 Auto-GPT 又有什么看法呢?

参考链接

https://weibo.com/1644684112/MBK3WCt8o

https://jina.ai/news/auto-gpt-unmasked-hype-hard-truths-production-pitfalls/

https://twitter.com/mranti/status/1646430121904013312?cxt=HHwWgIC8uaDepdktAAAA

本文来自微信公众号“CSDN”(ID:CSDNnews),作者:郑丽媛 ,

Comments are closed